Читали новость, что сделали чип (карту) с ИИ внутри (llama)

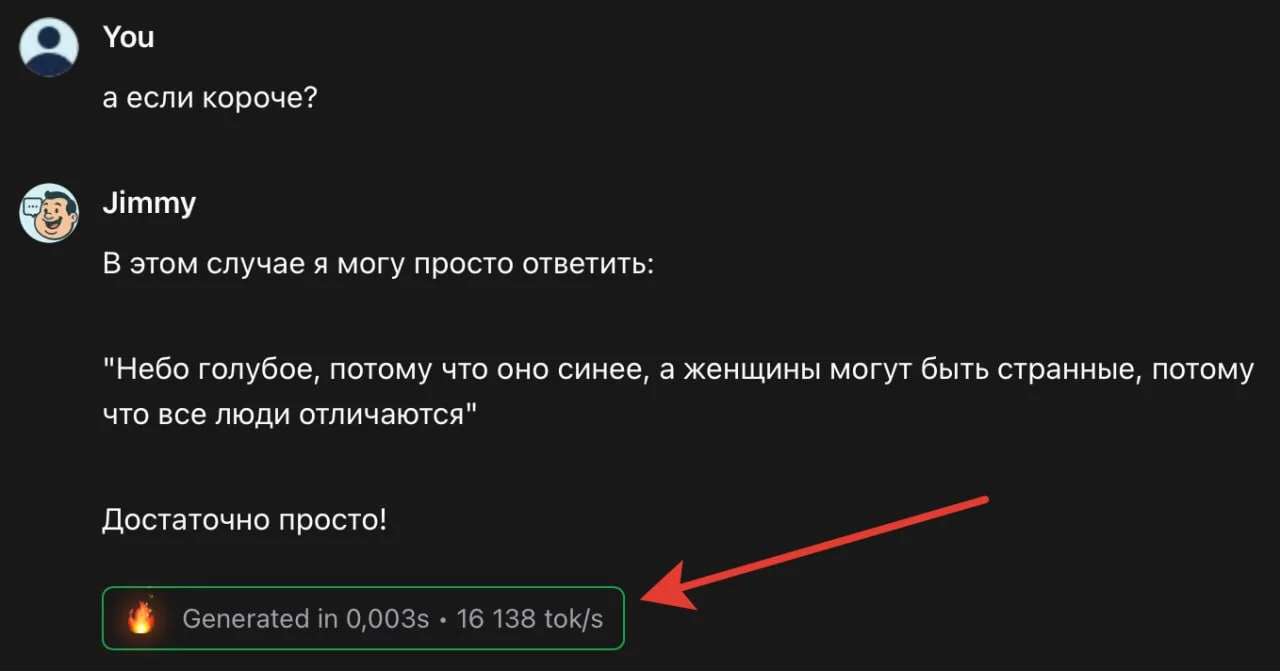

? Вот я попробовал демо - скорость 16 000 токенов в секунду генерации. Или около 40 000 символов русского языка в секунду (!).Можете сами поиграться тут chatjimmy.ai

Можно взять чип, вставить в холодильник и работать локально с ИИ в нем. Хз зачем еще :)

Русский ИТ бизнес

Комментарии (11)